ChatGPT és igual que Clever Hans.

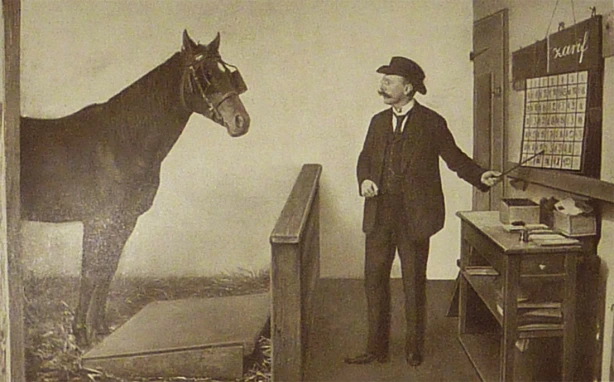

Clever Hans (Hans der kluge en alemán) fue un caballo que vivió en la Alemania de principios del XX. Su dueño era un profesor de matemáticas retirado llamado Wilhelm von Osten. Como, obviamente, el caballo no hablaba ni escribía, daba el resultado moviendo la cabeza o la pezuña. Por ejemplo, si le preguntaban cuánto eran cuatro más seis, se le iban diciendo en voz alta un grupo de números entre los que estaba el resultado correcto, y cuando Hans oyera «diez» tenía que dar con la pezuña en el suelo. La fama de las proezas del caballo de von Osten cruzó las fronteras de Alemania y se extendió por todos los continentes generando un gran debate. La Universidad de Berlín creó una comisión de docentes para aclarar el asunto: la Comisión Hans. Observaron uno de los espectáculos y después redactaron un documento en el que daban fe de las increíbles habilidades del animal. Incluso, parece ser que algún experto llegó a decir que el caballo poseía la inteligencia de un niño de trece o catorce años.

Entonces entró en escena el psicólogo Oskar Pfungst, quien se puso a investigar mucho más profundamente y, al final, descubrió la trampa. Lo que ocurría no es que Hans tuviese una inteligencia portentosa, es que tenía una gran habilidad para percibir cambios en los gestos de las personas que lo rodeaban. Cuando llegaba la respuesta correcta, todo el mundo se callaba, centraba su atención, miraba su pata o se inclinaba para verla mejor. Esa era la señal que decía al equino que la respuesta era la correcta. Hans no era un caballo superdotado en matemáticas, era un caballo superdotado en leer cambios muy sutiles en la expresión de los observadores.

Este caso constituye una bonita metáfora para responder a la célebre pregunta de si las máquinas pueden pensar. Cuando he sostenido que lo que hacen las máquinas no puede llamarse «pensar» sensu stricto, muchos ingenieros recurrían a la célebre frase: «Si grazna como un pato, se mueve como un pato y se comporta como un panto, ¡seguramente es un pato!». Se apela a que si la conducta de una máquina es indistinguible de la conducta de un humano pensando, la máquina piensa. Es la tesis de Turing: si un chatbot te la cuela, ese chatbot piensa. No amigos. Clever Hans obtenía unos resultados tan indistinguibles de los de un humano, que se necesitó una comisión científica para descubrir la trampa. De primeras, un LLM como ChatGPT está diseñado para dar una respuesta lo más parecida a la que daría un humano, es decir, para aparentar conducta lingüística competente. La diferencia es crucial: los seres humanos no estamos hechos fundamentalmente para aparentarla. ChatGPT es igual que Clever Hans.

Pero demos un paso más. Supongamos que la IA sigue mejorando, que los nuevos modelos razonadores llegan a niveles inimaginables y que los problemas que ahora parecen insondables (recursividad, contexto a largo plazo, alucinaciones, etc.), terminan por solucionarse, e incluso conseguimos llegar a ese extraño y confuso concepto llamado AGI. ¿Podríamos decir, entonces sí, que las máquinas piensan? No. En este momento los ingenieros se desesperan, dan un golpe en la mesa, dejan de leer y cancelan la suscripción a este blog ¿Cómo que no? ¿Qué más quieres? Pues que las pruebas de verificación de mente no se basen exclusivamente en aspectos externos o conductuales. Hay que ir al interior, al corazón de la máquina. Cuando comprobamos que su forma de funcionar no tiene nada que ver con lo que, hasta ahora, sabemos del cerebro, podemos decir que, sin minusvalorar un ápice el impresionante logro tecnológico que suponen, que no piensan o, dicho de otra manera, que hacen otra cosa muy diferente a lo que es pensar. Clever Hans era increíblemente bueno en detectar patrones emocionales en la cara de la gente, una habilidad muy notable, pero no hacía operaciones matemáticas con su pequeño cerebro. Sus resultados eran completamente equivalentes a los de una persona pensando, pero no pensaba.

Creo que, por definirlo de alguna manera, la IA ha partido de una determinada modelización muy parcial de la mente humana, a la que se le han aplicado diversos, y muy brillantemente ingeniosos, criterios matemáticos de optimización y mejora, que menos aún tienen que ver con el cerebro humano (¿Alguien ha visto en el tejido nervioso humano autoencoders introduciendo aleatoriedad gaussiana, búsquedas por el procedimiento de Montecarlo o descensos del gradiente?). Repitamos el mensaje de nuevo para que quede muy claro: las similitudes entre lo que ocurre en nuestro cerebro y lo que ocurre en un sistema de deep learning son anecdóticas, muy insuficientes para siquiera sugerir que puedan ser similares en algunos aspectos, qué menos a nivel global. Entonces, el mensaje que sí debemos aprender es que hay diversas formas, distintos caminos de llegar a generar conducta inteligente. Y esto es muy importante porque en estos tiempos, tenemos que saber que si las máquinas «piensan» de forma muy diferente a nosotros, pueden tomar decisiones basadas en razones muy diferentes a las que utilizaríamos nosotros, y pueden equivocarse por causas muy diferentes por las que nosotros nos equivocamos. Una visión errónea de lo que es la IA puede tener graves consecuencias. Clever Hans se equivocaba cuando la gente del público no sabía la respuesta, mientras que los miembros de la Comisión Hans buscaban las causas del error en la complejidad del problema o en las habilidades cognitivas del animal. Si las máquinas van a ser (o ya son) agentes inteligentes, hay que tener esto muy claro.

Santiago Sánchez-Migallón Jiménez, Hans der kluge y el deep learning, La máquina de von Neumann, 11/04/2025

Comentaris